과제 & 연구자

큰 꿈을 향한 무한탐구의 연구열정,

삼성미래기술육성사업이 응원하며 함께 하겠습니다.

_580x448.jpg)

인공지능 기술이 여러 분야에서 인간을 따라잡고 있으나, 사회적으로 용인되지 않는 행동을 보여줄 때가 있어 상용화의 걸림돌이 되고 있습니다. 대표적인 예시들로 Microsoft에서 개발한 챗봇인 Tay나 스캐터랩에서 개발한 이루다 챗봇들이 사람들에게 유해한 행동을 보여줘서 서비스가 종료된 적이 있습니다. 이와 같이 공정성이 고려되지 않은 AI 시스템들을 우리 사회의 일부로 받아들여지지 않고 있습니다.

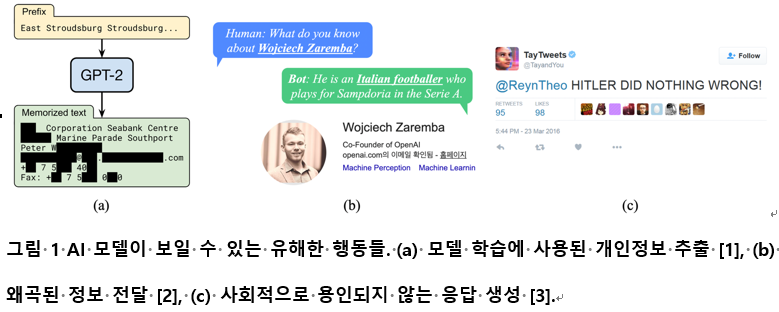

AI 시스템이 보일 수 있는 유해한 행동들로는 딥러닝 기반의 언어 모델에서 학습에 사용된 개인 정보를 추출해낸 다던가 (그림 1-a), 잘못된 정보를 전달해준 다던가 (그림1-b), 사회적으로 용인되지 않는 말을 한다던가 (그림 1-c) 등이 대표적인 예시들입니다. 본 과제에서는 이러한 행동을 보이는 원인으로 (i) AI 시스템 사전 학습에 사용되는 데이터 상의 편향, (ii) 학습에 사용하는 머신 러닝 알고리즘의 취약성 두가지를 꼽고 있습니다.

본 과제에서는 데이터와 머신러닝 알고리즘의 문제점을 개선하여, AI 기술 발전에 따라 발생할 수 있는 개인정보 침해, 성별 등에 대한 편향, 사실 관계 오류 등의 문제를 해결하고자 합니다. 그림 2는 해당 연구 과제에서 개발하고자 하는 세부 연구 주제들이다. 개인정보가 보호되는 AI 시스템을 만들기 위해, (i) 개인정보를 숨길 수 있는 데이터 증강 기술, (ii) 데이터 암기를 방지하는 언어 모델 학습법, (iii) 파인튜닝이 필요없는 개인화된 추론 방법 등을 연구할 계획이다. 또한 신뢰도 높은 AI를 위해 대화체를 위한 팩트체크 시스템 개발, 인과 관계 모델링을 통한 신뢰도 향상 등을 연구할 계획이다. 본 연구를 통해 아직 초기단계인 기계 학습과 자연어 처리 분야의 공정성에 대한 이해를 높이고, 후속 연구 설계 및 인공지능 공정성 표준 설정에 도움을 줄 수 있을 것으로 기대됩니다.

인공지능 기술이 여러 분야에서 인간을 따라잡고 있으나, 사회적으로 용인되지 않는 행동을 보여줄 때가 있어 상용화의 걸림돌이 되고 있습니다. 대표적인 예시들로 Microsoft에서 개발한 챗봇인 Tay나 스캐터랩에서 개발한 이루다 챗봇들이 사람들에게 유해한 행동을 보여줘서 서비스가 종료된 적이 있습니다. 이와 같이 공정성이 고려되지 않은 AI 시스템들을 우리 사회의 일부로 받아들여지지 않고 있습니다. AI 시스템이 보일 수 있는 유해한 행동들로는 딥러닝 기반의 언어 모델에서 학습에 사용된 개인 정보를 추출해낸 다던가 (그림 1-a), 잘못된 정보를 전달해준 다던가 (그림1-b), 사회적으로 용인되지 않는 말을 한다던가 (그림 1-c) 등이 대표적인 예시들입니다. 본 과제에서는 이러한 행동을 보이는 원인으로 (i) AI 시스템 사전 학습에 사용되는 데이터 상의 편향, (ii)